说起来,流水线应该是FPGA/数字电路设计里最常见的优化手段了。入门的时候大家都学过:想提升时钟频率,就把大组合逻辑拆成多级,中间插寄存器。这招确实管用,一用一个准。

但问题来了——流水线是不是越深越好?频率跑不上去就无脑加寄存器,这样行不行?

按我的经验,这条路走到后面会踩坑。今天咱们就来聊聊,流水线深度到底怎么选,加太深会有哪些副作用。

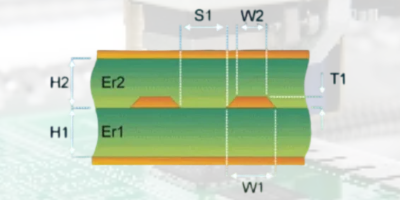

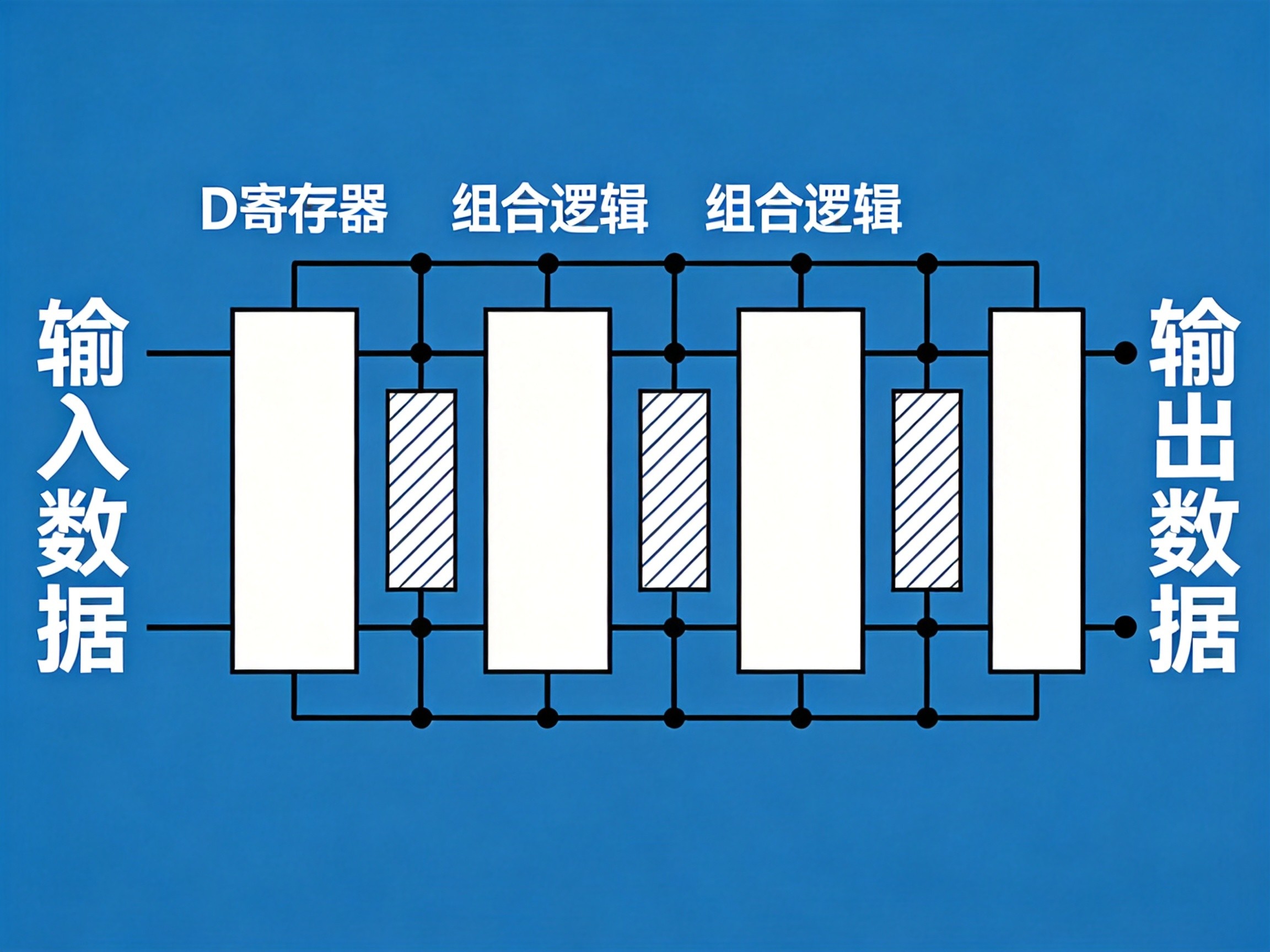

先回顾一下流水线的基本原理流水线之所以能提升频率,本质上是在缩短关键路径的延迟。数字电路的时钟周期要满足这个约束:

T_clk ≥ T_setup + T_delay + T_clk_q + T_skew

其中T_delay就是组合逻辑路径的延迟,这个是我们能控制的。你把一个大组合逻辑拆成两级,每级延迟就变成原来的一半;拆成四级,每级就变成四分之一。这么一来,时钟周期可以设得更短,频率自然就上去了。

加深流水线的本质是减少T_delay。

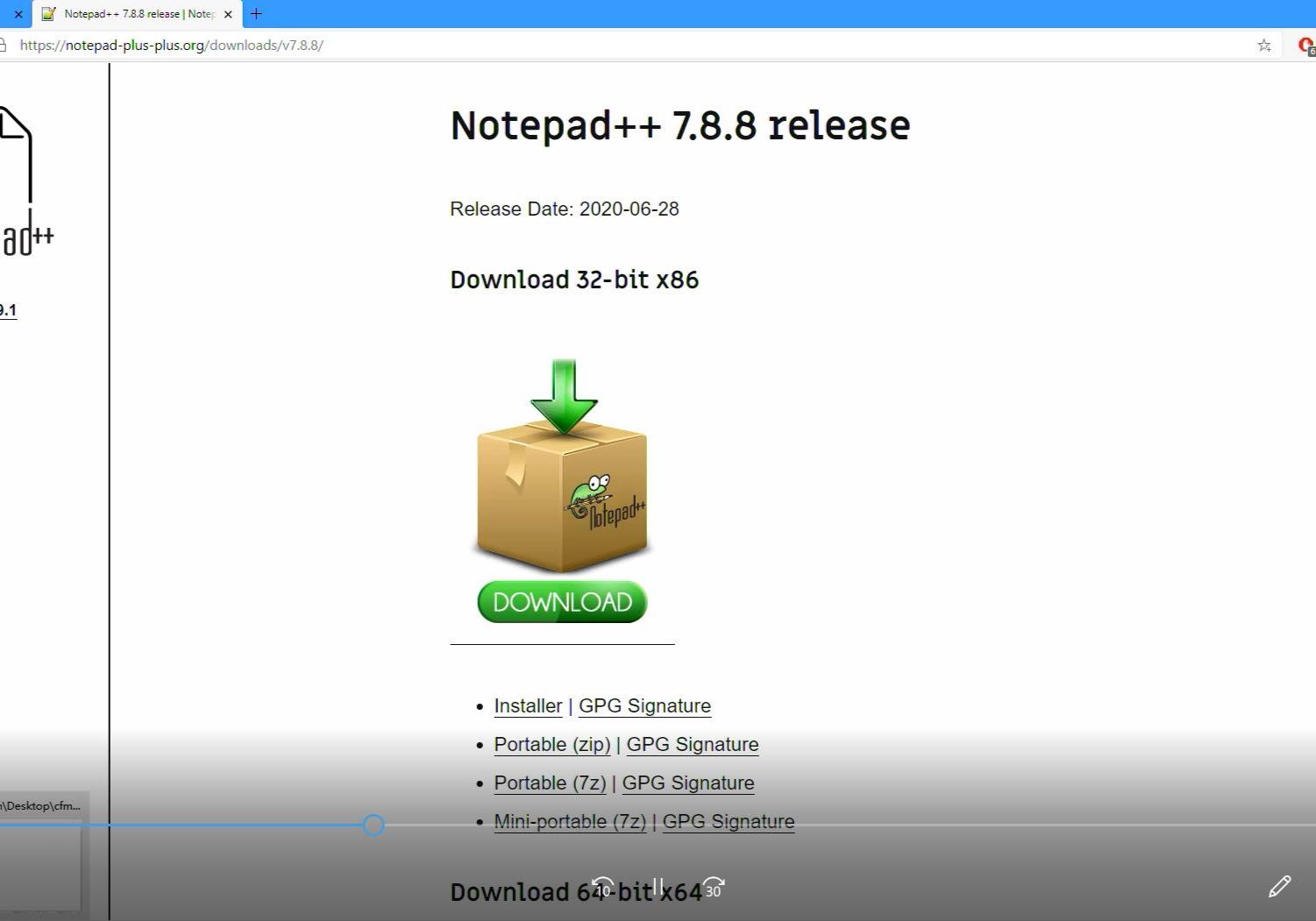

流水线基本结构:数据依次经过寄存器、组合逻辑处理后输出

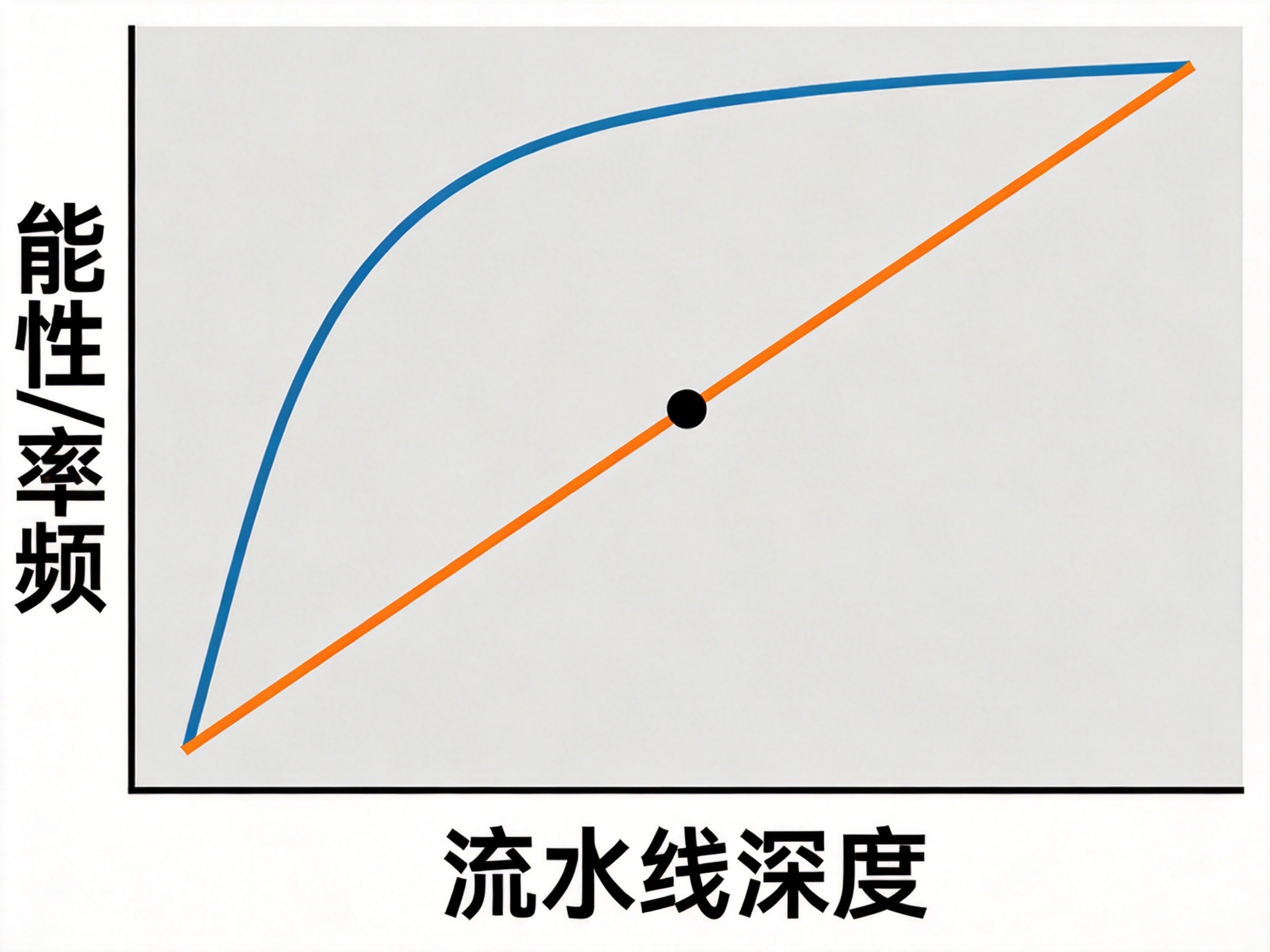

但收益不是线性的,越往后越不值刚做流水线优化的时候,效果往往很明显。比如你从1级变成4级,频率可能直接翻倍。但从4级变成8级,频率提升可能只有20%。再从8级到16级?说不定只提升了5%。

这就是典型的边际收益递减。流水线的收益曲线大概是这样的:

浅流水阶段:每加一级,效果立竿见影

中等流水:还能继续涨,但幅度在缩小

深流水阶段:单级已经很浅了,继续分下去,增加的寄存器开销远远大于频率收益

当你发现多加一级寄存器,频率只提升了一点点甚至没提升,这时候就该停手了。

流水线深度与频率/性能的关系:边际收益递减明显

流水线加太深的副作用说完收益递减,咱们来看看深流水线的副作用。这些问题很多人刚开始做的时候不会想到,等到踩坑了才后悔。

1. Latency增加数据从进入流水线到输出,需要经过所有级。如果原来是4级流水,数据进来4个周期后能出来;现在改成16级,就得等16个周期。

这个问题在实时性要求高的场景下很要命。比如高速接口、实时控制、流水线处理器核间通信,Latency大了直接导致系统响应变慢,某些场景甚至根本没法用。

2. 面积增大每加一级寄存器,都需要占用FF资源。一个32位的数据通路,加一级就是32个D触发器;你要是加8级,就多占用256个触发器。

在资源本来就紧张的FPGA设计里,这种开销不容忽视。有时候你加了流水线,时序稍微好了一点点,但面积蹭蹭往上涨,综合一看反而亏了。

3. 功耗上升更多寄存器意味着更多时钟翻转。触发器的功耗主要来自时钟端的翻转,深流水线模块的动态功耗往往比浅流水线的同类模块高出不少。

做低功耗设计的时候,这一点尤其要警惕。频率是上去了,功耗也跟着涨,续航敏感型设备可能扛不住。

4. 布局布线拥塞寄存器一多,需要连的线也跟着多。深流水线的模块在布局时很容易遇到拥塞问题——资源倒是够,但线绕不过去。

FPGA开发里有个常见的现象:加了流水线,时序报告反而变差了。很大一部分原因就是拥塞导致的走线延迟增加。遇到这种情况,得慎重考虑是不是流水线的深度出了问题。

5. 调试困难流水线级数多了之后,debug难度直线上升。数据在某个周期出不来,你得一级一级去排查,看看到底是哪一级的状态出了问题。

浅流水线的设计,仿真波形看几眼就能定位问题;深流水线的模块,波形图又长又乱,有时候绕半天才能找到bug在哪。

6. IPC可能下降这里主要针对CPU流水线的场景。深流水线提升了时钟频率,但如果程序本身的指令级并行度(ILP)不高,处理器就无法充分利用流水线,IPC就会下降。

说白了,频率上去了,但每个周期能干的事少了,综合性能不一定更好。这也是为什么有些处理器设计会选择更浅的流水线——比如一些嵌入式场景,简单高效比高频更重要。

怎么确定合适的流水线深度讲了这么多副作用,不是说流水线不能用,而是要用的恰到好处。那问题来了:到底多深才合适?

第一步:先测,后优化

不要凭感觉加流水线。先用综合工具和时序报告把关键路径跑一遍,找出最紧张的那几条路。瓶颈在哪里,就优化哪里。

第二步:考虑Latency的容忍度

你的应用场景能接受多大的Latency?如果是高速串行接口这种对延迟敏感的场景,流水线得悠着点加。如果是通用计算,Latency大一点问题不大,可以多堆几级。

第三步:看资源预算

FPGA资源紧张的时候,深流水线可能引入拥塞,反而让时序变差。这种情况下与其继续加深,不如换个思路——优化逻辑结构、减少关键路径上的资源争用。

第四步:平衡频率和综合收益

加流水线是为了提升频率,但频率只是性能的一个维度。面积、功耗、Latency、调试难度都要考虑进去。找一个在你的约束条件下综合最优的深度,而不是单纯追求最高频率。

实战案例说个我之前做FFT处理器的经历。刚开始用4级流水线,频率只能跑200MHz,时序报告里关键路径是一大块蝶形运算单元。

优化了一版,把蝶形运算拆成8级,频率直接跳到350MHz,效果很明显。继续拆,拆到16级流水线,频率爬到了380MHz——只提升了8.5%,但Latency翻倍了,综合出来的LUT和FF使用量涨了将近20%。

算了一下投入产出比,果断停在了8级。这个案例很典型:深流水线的边际收益递减在这里体现得淋漓尽致。

FPGA开发板:资源有限时需权衡流水线深度与资源开销

再比如CPU流水线。ARM7用的是3级流水,结构简单,频率不高但功耗控制得很好,适合嵌入式场景。后来ARM9提升到5级,再往后Cortex-A系列高频版本用到了十几级流水线,频率上去了,但芯片面积和功耗也水涨船高。

不同场景用不同的深度,这本身就是一种权衡。

总结一下流水线是提升频率的好手段,但不是越多越好。加太深会带来Latency增加、面积变大、功耗上升、拥塞加剧、调试困难等一系列副作用。

确定合适的深度,关键是:先测量再决策,考虑Latency容忍度,看资源预算,平衡频率和综合收益。

最合适的流水线深度,不是在所有条件下都追求极致,而是在你的约束条件下综合最优的那个点。

扫码关注

扫码关注